O Que é o Protocolo MCP e Como Ele Funciona

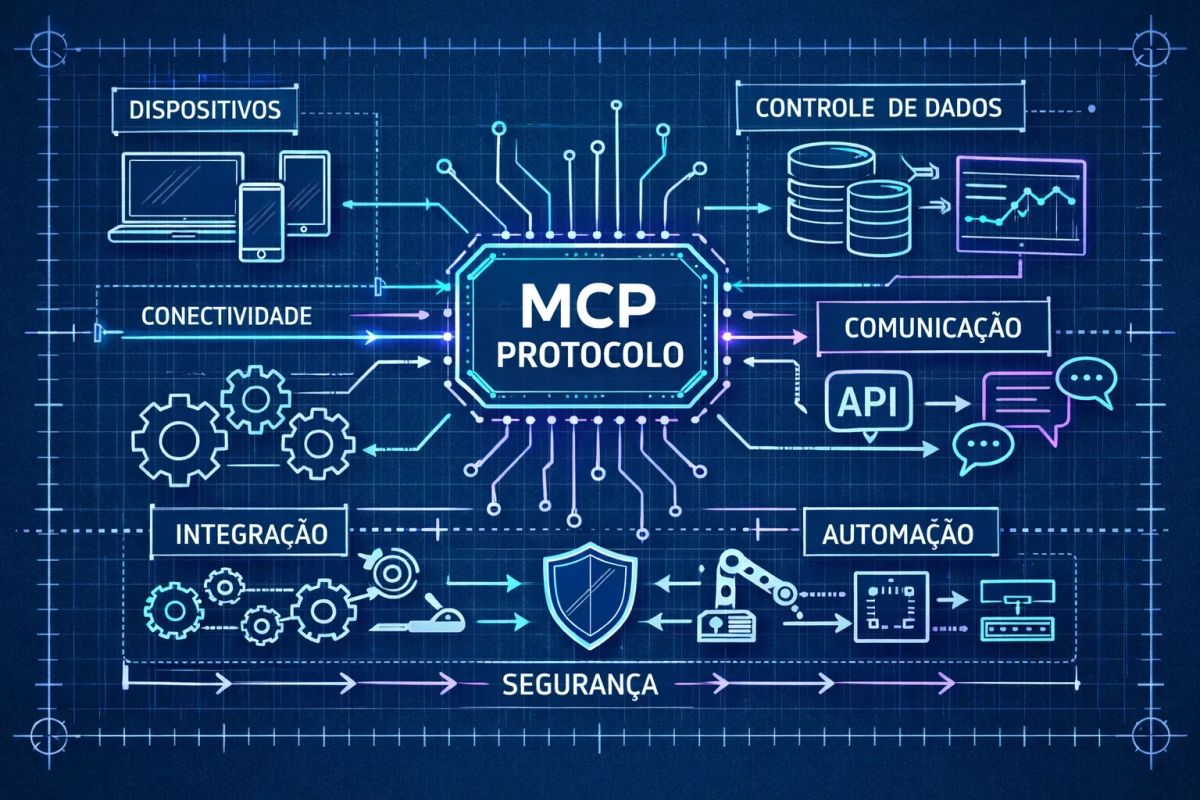

O protocolo mcp é a especificação open source que padroniza como LLMs se conectam a ferramentas e fontes de dados externas. Também chamado de Model Context Protocol ou Protocolo de Contexto de Modelo, funciona como uma porta única para IA: um adaptador que facilita integrações entre modelos e ferramentas sem contratos proprietários, semelhante ao Language Server Protocol para contexto de modelos. A ideia central é permitir conexões previsíveis e reutilizáveis entre diferentes LLMs e infraestruturas.

A especificação MCP foi desenhada com princípios claros: interoperabilidade, composicionalidade, descoberta de capacidades e segurança integrada. Ser agnóstico a provedor evita vendor lock-in e permite trocar servidores ou connectors sem reescrever clientes; decisões sobre transporte e segurança (por exemplo JSON-RPC, TLS e permissões) suportam esse objetivo. Para times de desenvolvimento isso se traduz em menos integrações custom, connectors reaproveitáveis e workflows compostos que ficam mais fáceis de manter.

Resumo rápido

O protocolo mcp padroniza a comunicação entre LLMs e ferramentas externas e define papéis (Host, Cliente, Servidor), transportes recomendados e um ciclo de vida de sessão para negociar capacidades. Com ele você reutiliza connectors, compõe workflows sem reescrever clientes e reduz a dívida técnica de integrações ad hoc. Em produção, aplique políticas de permissões, auditoria e limites de dados para controlar quem invoca ferramentas e evitar vazamentos. Um bom ponto de partida é provar um POC: rodar um servidor local, validar um conector crítico e iterar rapidamente. Para quem busca documentação de referência sobre o Model Context Protocol, a página do Model Context Protocol traz um panorama útil.

1. O que é o protocolo MCP e por que ele mudou a integração entre LLMs e ferramentas

Para times de desenvolvimento os ganhos aparecem rapidamente: menos código bespoke, reaproveitamento de connectors MCP e capacidade de montar workflows compostos com ferramentas existentes. Por exemplo, ao trocar um servidor MCP por outro, o cliente pode continuar funcionando graças à descoberta de capacidades e aos contratos padronizados. A próxima seção descreve a arquitetura técnica e o ciclo de vida de sessão para orientar implementações de host e servidor. Para uma visão de mercado e casos de uso empresariais que ilustram esse impacto, veja também o artigo da IBM sobre Model Context Protocol.

2. Arquitetura do MCP: componentes, transporte e ciclo de vida

A especificação MCP define três papéis: Host, Cliente e Servidor. O Host é a interface do usuário ou IDE que inicia sessões e agrega respostas — por exemplo, um plugin no Visual Studio Code ou uma aplicação desktop que integra um agente. O Cliente atua como orquestrador, decidindo quando solicitar contexto ou chamar ferramentas, enquanto o Servidor expõe recursos, ferramentas e connectors; ele pode ser um microserviço local ou um provider remoto.

O protocolo usa JSON-RPC 2.0 para padronizar requisições, respostas e notificações, o que facilita a integração entre stacks diferentes e com fontes externas. Transportes comuns incluem stdio (bom para processos locais), WebSocket (baixa latência bidirecional), HTTP SSE (streaming unidirecional) e soquetes UNIX. Um handshake típico usa um JSON simples de negociação de capacidades, por exemplo {"jsonrpc":"2.0","method":"handshake","params":{"capabilities":["streaming","tool-invoke"]}}; escolha o transporte conforme a necessidade: stdio para simplicidade, WebSocket para interatividade e SSE para cenários de streaming unidirecional.

O ciclo de vida segue quatro passos: inicialização, negociação de capacidades, operação (com streaming e notificações) e encerramento. Durante a operação o servidor pode enviar notificações ou solicitar inputs ao cliente; por exemplo, pedir amostras que o cliente retorna como stream de tokens ou alternativas, e então incorporar essas respostas ao output final. Esses padrões bidirecionais exigem discovery e verificações de segurança no início da sessão e um encerramento limpo ao final.

3. Como agentes de IA leem e interagem com bases de código e ferramentas externas via MCP

Resources e tools têm papéis distintos quando um agente acessa o ambiente. Resources oferecem leitura e contexto sem causar efeitos colaterais — por exemplo, um índice de código, um snapshot de documentação ou metadados de PR — enquanto tools executam ações com impacto, como rodar testes, criar branches ou enviar notificações. Use resources para consultas seguras e tools para operações que mudam o estado do sistema.

O fluxo prático vai do prompt até o resultado final em quatro etapas claras: o host recebe a instrução, o cliente resolve qual recurso ou ferramenta é necessário, o cliente chama o servidor via protocolo mcp e o LLM compõe a resposta usando o retorno para decidir os próximos passos. O protocolo suporta streaming e interações bidirecionais, então respostas parciais podem aparecer antes da operação terminar. Planeje prompts e templates que forcem o agente a pedir bindings quando necessário, evitando execuções inesperadas.

A chamada JSON-RPC mínima para pedir um recurso pode ser algo como {"jsonrpc":"2.0","method":"getResource","params":{"name":"repo_index","path":"src/"},"id":42}. Esse padrão deixa claro o contrato entre cliente e servidor e facilita validação automática do payload. Para consultas sensíveis a bancos, use prompts que exijam apenas operações read-only, bindings para valores e limites de resultados para evitar alterações acidentais.

Conexões típicas incluem buscas no GitHub para resumos de PRs, consultas SQL para histórico de esquema, eventos do Sentry para depuração e Playwright para testes de fluxo. Com esses connectors você pode automatizar revisões colaborativas e testes end-to-end, por exemplo orquestrando execução de testes e geração de patches via um agente. A seção seguinte aborda padrões de segurança e políticas de permissão para esses cenários.

4. Casos de uso empresariais e exemplos reais que aceleram desenvolvimento

O protocolo mcp habilita automações que encurtam o ciclo entre detecção e correção de bugs mantendo auditoria e controle. Ao expor erros de produção, traces e metadados via connectors, um agente pode gerar um rascunho de PR, executar pipelines de teste e até fechar issues quando tudo passar. Isso reduz o tempo de resolução e mantém logs e permissões dentro do fluxo de trabalho para evitar mudanças não autorizadas.

Um fluxo típico inclui receber um stack trace do Sentry, localizar o código afetado no repositório, propor um patch com testes mínimos, abrir um PR automatizado e acionar pipelines CI para validar as mudanças. Se os checks falharem, o sistema reabre a issue e notifica engenheiros relevantes; se passarem, o PR é mesclado e o processo fica registrado para compliance. Esses passos podem ser orquestrados por um runner customizado ou por ferramentas como n8n, sempre com gates humanos e rollback automático quando necessário.

Relatórios e integrações com ferramentas de negócio ficam mais simples quando o agente tem acesso a dados para modelos. Um conector SQL pode gerar um resumo semanal de métricas, atualizar campos no CRM e criar tarefas em ferramentas como Linear ou Salesforce, tudo com histórico versionado para auditoria. Planeje jobs agendados que rodem queries, gerem textos em linguagem natural e enviem resultados a stakeholders via email ou Slack.

5. Segurança e governança: melhores práticas para usar MCP em produção

Segurança e governança são requisitos essenciais ao levar o protocolo mcp para produção. Defina políticas desde o início: quem pode invocar ferramentas, quais dados podem sair do sistema e como auditar cada sessão. Essas decisões diminuem riscos operacionais e permitem respostas rápidas a incidentes sem interromper o serviço.

Implemente controle de acesso com princípio do menor privilégio usando RBAC, scopes por tenant e rotação automática de tokens. Valide comandos antes da execução para bloquear ações fora do escopo autorizado e mantenha logs de consentimento e auditoria. Além disso, segmente a infraestrutura com sandboxes e execução em contêineres para limitar o blast radius e proteja transportes com TLS — consulte as práticas de segurança para MCP da Microsoft para recomendações operacionais detalhadas.

Valide payloads com JSON Schema, sanitize entradas e saídas para mitigar prompt injection e masque dados sensíveis nos logs. Colete métricas e tracing (por exemplo, OpenTelemetry), aplique rate limits e disjuntores para prevenir abuso e teste connectors em ambientes de staging com cargas reais antes do deploy. Com essas práticas você terá governança operacional clara e preparação para monitoramento contínuo e resposta a incidentes.

6. Comece hoje: SDKs, repositórios, roteiro de POC e recursos

Para implementar o protocolo mcp rapidamente, clone os repositórios oficiais e instale os SDKs de referência; isso reduz o tempo até ter um servidor local e um host negociando capacidades. Use clientes Python ou Node para testes rápidos e aproveite exemplos de servidores que mostram WebSockets e HTTP SSE em ação. Combine essas bases com bibliotecas de indexação, como LlamaIndex ou Chroma, quando precisar armazenar e recuperar contexto. Um bom repositório para começar é o mcp-for-beginners da Microsoft, que traz exemplos e traduções úteis.

Um roteiro de POC prático em poucas horas ajuda a validar valor antes de escalar. Rode um servidor MCP local com um connector simples (por exemplo, pesquisa no GitHub), conecte um host que negocie capacidades e verifique permissões e streaming; por fim, execute uma tarefa completa monitorando logs, autenticação, rate limiting e auditoria. Esses passos permitem iterar rápido e comprovar ganhos operacionais sem investir em uma integração complexa imediatamente. Se seu objetivo é automatizar tarefas de desenvolvimento como parte do POC, veja nosso guia sobre como usar Claude Code para automatizar tarefas de dev para ideias práticas de integração.

Resumo do checklist prático: coloque um servidor de referência no ar, valide schemas JSON das respostas, confirme a negociação de capacidades entre host e cliente e teste os fluxos de autorização. Em seguida, integre um conector crítico e execute testes end-to-end em staging antes de promover para produção. Documente permissões e retenha logs imutáveis para compliance.

Resumo prático e próximos passos

Para começar: clone um repositório pequeno, implemente um Host compatível com a especificação MCP, conecte um agente LLM e execute um teste end-to-end. Na DevSkill você encontra guias práticos, templates de prompt e exemplos de código para cada etapa; o próximo passo é colocar um POC em funcionamento, revisar logs e métricas e iterar com segurança. Saiba mais sobre o DevSkill e, se quiser se aprofundar em prompts e workflows, acompanhe nosso material em Como Dominar Engenharia de Prompts para IA Eficiente.